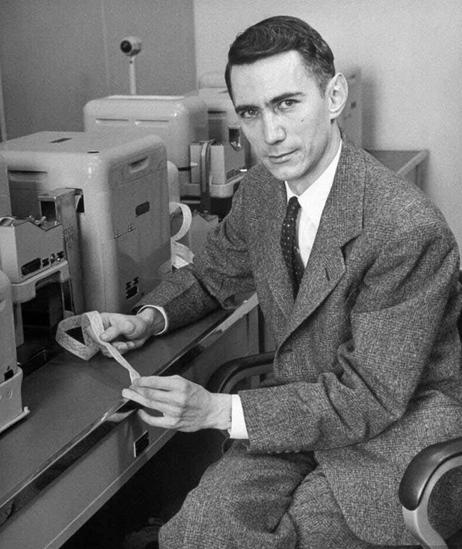

香农既精通通信又精通数学,将数理知识和工程很好的融合在一起。大数学家Kolmogrov很好地总结了香农作为一个学者的才华,他说:“在我们的时代,当人的指示越来越专业化的时候,香农是科学家的一个卓越的典范。他把深奥和抽象的数学思想和概括而又很具体的对关键技术问题的理解结合起来。他被认为是最近几十年最伟大的工程师之一,同时也被认为是最伟大的数学家之一。”

熵(entropy)的概念

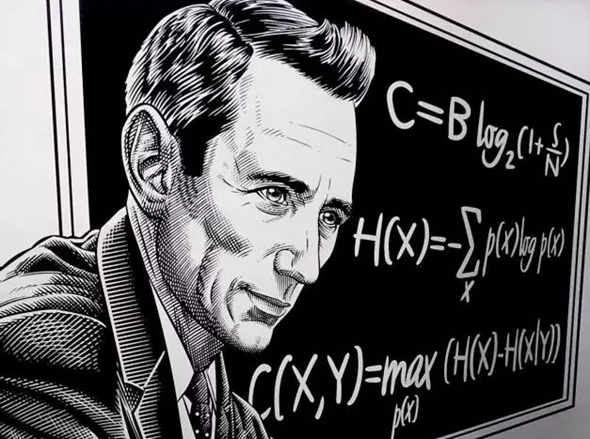

香农理论的重要特征是熵(entropy)的概念,他证明熵与信息内容的不确定程度有等价关系。熵曾经是波尔兹曼在热力学第二定律引入的概念,我们可以把它理解为分子运动的混乱度。香农将统计物理中熵的概念,引申到信道通信的过程中,从而开创了”信息论“这门学科。香农定义的“熵”又被称为“香农熵”或“信息熵”,即其中i标记概率空间中所有可能的样本,表示该样本的出现几率,K是和单位选取相关的任意常数。可以明显看出“信息熵”的定义和“热力学熵”(玻尔兹曼公式)的定义只相差某个比例常数。 熵(entropy)指的是体系的混乱的程度,它在控制论、概率论、数论、天体物理、生命科学等领域都有重要应用,在不同的学科中也有引申出的更为具体的定义,是各领域十分重要的参量。熵由鲁道夫·克劳修斯(Rudolf Clausius)提出,并应用在热力学中。后来在,克劳德·艾尔伍德·香农(Claude Elwood Shannon)第一次将熵的概念引入到信息论中来。 众所周知,质量、能量和信息量是三个非常重要的量。

人们很早就知道用秤或者天平计量物质的质量,而热量和功的关系则是到了19世纪中叶,随着热功当量的明确和能量守恒定律的建立才逐渐清楚。能量一词就是它们的总称,而能量的计量则通过“卡、焦耳”等新单位的出现而得到解决。 然而,关于文字、数字、图画、声音的知识已有几千年历史了。但是它们的总称是什么,它们如何统一地计量,直到19世纪末还没有被正确地提出来,更谈不上如何去解决了。20世纪初期,随着电报、电话、照片、电视、无线电、雷达等的发展,如何计量信号中信息量的问题被隐约地提上日程。

1928年哈特利(R.V. H. Harley)考虑到从D个彼此不同的符号中取出N个符号并且组成一个“词”的问题。如果各个符号出现的概率相同,而且是完全随机选取的,就可以得到D^N个不同的词。从这些词里取了特定的一个就对应一个信息量I。哈特利建议用N log D这个量表示信息量,即I=N log D。这里的log表示以10为底的对数。后来,1949年控制论的创始人维纳也研究了度量信息的问题,还把它引向热力学第二定律。

但是就信息传输给出基本数学模型的核心人物还是香农。1948年香农长达数十页的论文“通信的数学理论”成了信息论正式诞生的里程碑。在他的通信数学模型中,清楚地提出信息的度量问题,他把哈特利的公式扩大到概率pi不同的情况,得到了著名的计算信息熵H的公式:H(X)= -Σp(x) logp(x) 如果计算中的对数log是以2为底的,那么计算出来的信息熵就以比特(bit)为单位。在计算机和通信中广泛使用的字节(Byte)、KB、MB、GB等词都是从比特演化而来。“比特”的出现标志着人类知道了如何计量信息量。香农的信息论为明确什么是信息量概念作出决定性的贡献。 香农在进行信息的定量计算的时候,明确地把信息量定义为随机不定性程度的减少。这就表明了他对信息的理解:信息是用来减少随机不定性的东西。或香农逆定义:信息是确定性的增加。

虽然香农的信息概念比以往的认识有了巨大的进步,但仍存在局限性,这一概念同样没有包含信息的内容和价值,只考虑了随机型的不定性,没有从根本上回答"信息是什么"的问题。

事实上,香农最初的动机是把电话中的噪音除掉,他给出通信速率的上限,这个结论首先用在电话上,后来用到光纤,截止2013又用在无线通信上。我们能够清晰地打越洋电话或卫星电话,都与通信信道质量的改善密切相关。